Tener millones de peticiones en tu aplicación es el “problema feliz” que toda startup desea tener. Sin embargo, si tu puerta de entrada no es lo suficientemente robusta, ese tráfico se convierte en un ataque DDoS autoinfligido que puede tumbar tu backend y disparar tu factura de la nube.

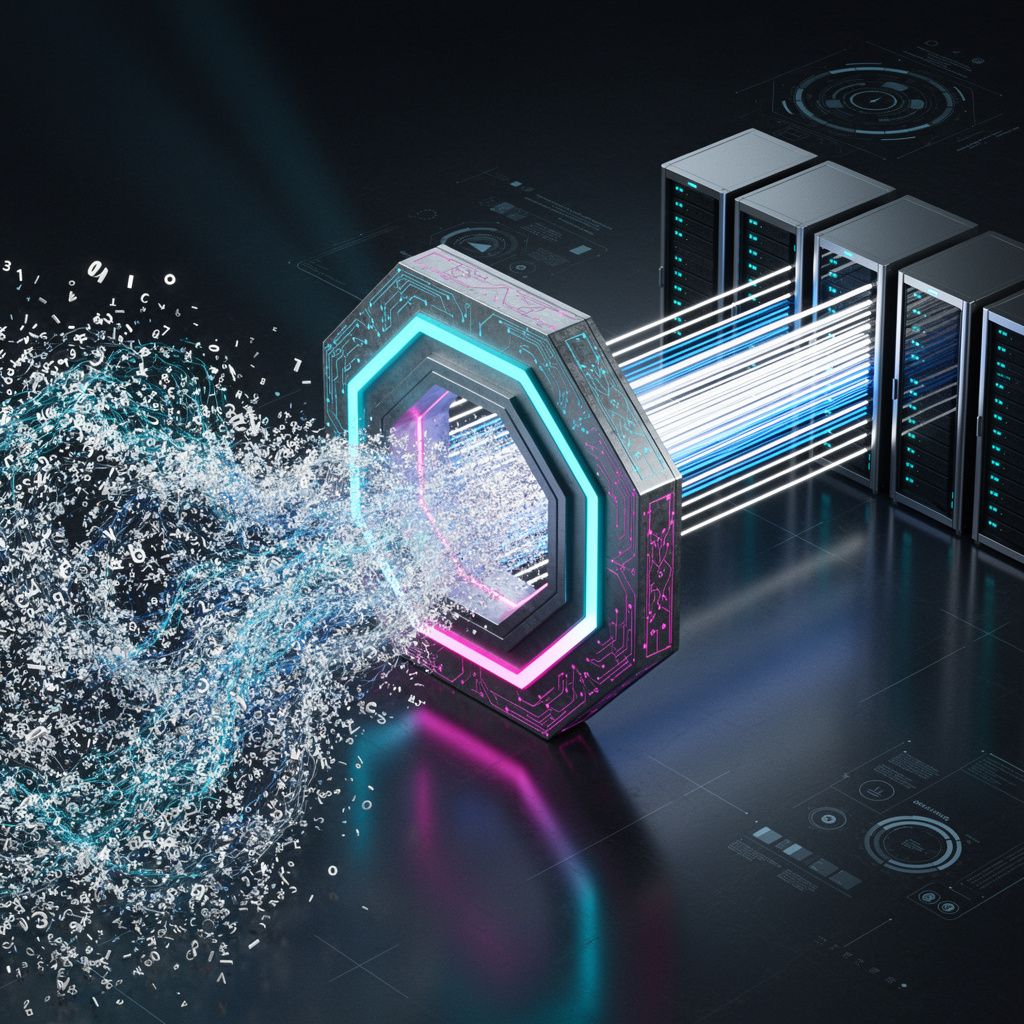

Amazon API Gateway es mucho más que un simple enrutador de tráfico. Es un escudo, un acelerador y un gestor de tráfico.

En Tijiki, hemos configurado gateways que procesan miles de transacciones por segundo durante eventos masivos. Aquí te explicamos las 3 configuraciones críticas que separan a una API amateur de una profesional.

[Image of AWS API Gateway architecture diagram]

1. Domina el “Throttling” (El Control de Flujo)

El error número uno es dejar la API abierta sin límites. Si un script malicioso o un error en el frontend envía 10,000 peticiones por segundo, tu base de datos explotará.

Debes configurar el Throttling a dos niveles:

- Rate (Tasa): El número promedio de peticiones por segundo (RPS) que permites.

- Burst (Ráfaga): El “colchón” para picos repentinos. Funciona con el algoritmo Token Bucket. Imagina un balde que se llena de fichas; si el balde se vacía, las peticiones se rechazan (Error 429: Too Many Requests) hasta que se rellene.

Consejo Pro: No apliques un límite global único. Usa Usage Plans y API Keys para dar límites más altos a tus clientes premium y límites más estrictos a los usuarios gratuitos o anónimos.

2. Activa el Caching (La Velocidad Gratis)

¿Por qué procesar la misma petición 1,000 veces si la respuesta no ha cambiado?

API Gateway tiene una caché integrada que puede guardar las respuestas de tu backend (Lambda, EC2, DynamoDB) por un tiempo determinado (TTL).

- Beneficio de Latencia: El usuario recibe la respuesta en milisegundos directamente desde el borde (Edge), sin tocar tu backend.

- Beneficio de Costo: Reduces drásticamente las ejecuciones de Lambda y las lecturas de base de datos.

Configuración recomendada: Activa el caché solo para métodos GET seguros e idempotentes. Nunca lo actives para endpoints con datos sensibles o en tiempo real sin una estrategia de invalidación adecuada.

3. Integraciones Directas (Saltarse el Intermediario)

Muchos desarrolladores usan el patrón: API Gateway -> Lambda -> DynamoDB.

Para operaciones simples de CRUD (como leer un producto por ID o guardar un formulario de contacto), la función Lambda es a veces un intermediario innecesario que añade latencia y costo.

AWS Service Proxies: Puedes configurar API Gateway para que hable directamente con servicios como DynamoDB, Kinesis o SQS.

- Ejemplo: Un endpoint de ingestión de datos IoT. En lugar de invocar una Lambda para guardar el dato, API Gateway lo inserta directo en SQS o Kinesis Firehose.

- Resultado: Menor latencia, cero “Cold Starts” y mayor capacidad de manejo de concurrencia masiva.

4. Seguridad: WAF es obligatorio

Cuando manejas millones de peticiones, no todas son amistosas. Conecta AWS WAF (Web Application Firewall) a tu API Gateway.

Esto te permite bloquear automáticamente:

- Inyecciones SQL.

- Direcciones IP de reputación dudosa (Botnets).

- Patrones de tráfico que parecen ataques DDoS de capa 7 (Aplicación).

Conclusión

Soportar millones de peticiones no se trata solo de tener servidores grandes; se trata de gestionar el tráfico inteligentemente antes de que toque tus servidores. Una configuración correcta de API Gateway protege tu infraestructura y garantiza una experiencia de usuario fluida incluso en los momentos de mayor estrés.

¿Tu API es lenta o inestable bajo carga alta? En Tijiki, auditamos tu infraestructura actual y aplicamos las mejores prácticas de la industria para garantizar escalabilidad y seguridad.